NVIDIA®

GPU

Compute

Capability

|

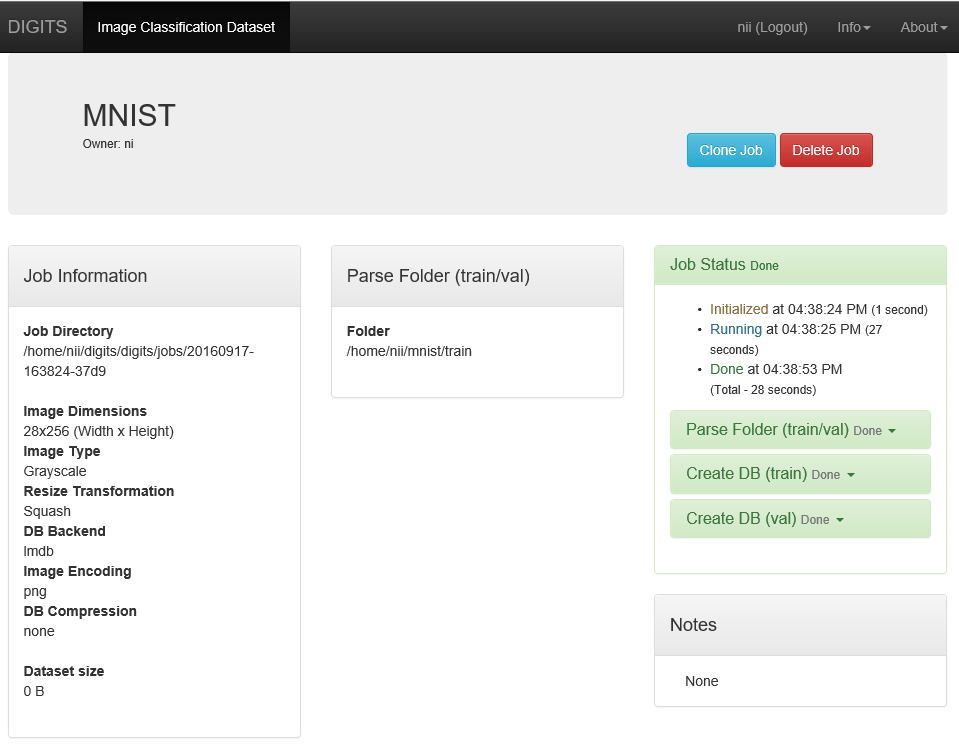

NVIDIA® GPU(Graphics Processing Unit) のハードウェア要件としまして、Deep Learningに必要な、DIGITS、cuDNN や Caffe を動作させるためには、CUDA のバージョンは 7.0 以上、 Kepler microarchitecture 以降のアーキテクチャの GPU で、Compute Capability が 3.0 以上である必要があります。

Fermi アーキテクチャー の GPU は、Compute Capability が 2.0 / 2.1 であるため、残念ながら Deep Learning 用には使用することができません。

Tesla GPU である C2075 / C2070 / C2050 は、Fermi アーキテクチャー であり、Compute Capability が 2.0 であるため、同様に Deep Learning 用には使用することができません。

GeForce GPUs with Kepler or higher アーキテクチャー (CUDA 7.5 Installation Guide)

CUDA 7.0 and a GPU of compute capability 3.0 or higher are required. (cudnn_install.txt)

Kepler は 3.0 ~ 3.5、Maxwell は、5.0 以上となりますので、勿論 Deep Learning 開発様に使用することが可能です。

Pascal アーキテクチャー は、Compute Capability が 6.0 以上となります。

Turing アーキテクチャー は、Compute Capability が 7.0 以上となります。

https://developer.nvidia.com/cuda-gpus

http://docs.nvidia.com/cuda/cuda-c-programming-guide/#compute-capability

http://docs.nvidia.com/cuda/cuda-c-programming-guide/index.html#compute-capabilities

※NVIDIA® Deep Learning (深層学習) 開発環境に対応したGPUの例

Tesla K20 (3.5) / K40 (3.5) / K80 (3.7) / M40 (5.2)

Quadro 410 (3.0) / K420 (3.0) / K600 (3.0)

Quadro K2000 (3.0) / K4000 (3.0) / K4200 (3.0) / K5000 (3.0) / K5200 (3.2) / K6000 (3.5)

Quadro K620 (5.0) / K1200 (5.0) / K2200 (5.0)

Quadro M2000 (5.2) / M4000 (5.2) / M5000 (5.2) / M6000 (5.2)

Quadro NVS 510 (3.0) / 810 (5.0)

Jetson TK1 (3.2) / Tegra K1 (3.2) / Tegra X1 (5.2)

GT 640 [GDDR5] (3.5) / GTX 650 (3.0) / GTX 660 (3.0) / GTX 670 (3.0)

GeForce GTX 750 (5.0) / GTX 760 (5.0) / GTX 770 (5.0) / GTX 780 (5.0)

GeForce GTX 950 (5.2) / GTX 960 (5.2) / GTX 970 (5.2) / GTX 980 (5.2)

GeForce GTX TITAN (3.5) / GTX TITAN Black (3.5) / GTX TITAN Z (3.5) / GTX TITAN X (5.2)

NVIDIA Quadro M6000 24GB (5.2, 24GB GDDR5, 3072 Core, 384bit, 317GB/s, 250W, ECC対応, DVI-Ix1, DP1.4x4)

● NVIDIA® Volta™ アーキテクチャー GPU

TITAN V (7.0, 12GB HBM2, CUDA 5120 Core, Tensor 640 Core, 1200 - 1455 MHz, 3072 bit, 652.8 GB/s, TDP 250W)

● NVIDIA® Pascal™ アーキテクチャー GPU

・NVIDIA® GeForce® GPU

http://www.nvidia.co.jp/object/geforce_family_jp.html

CUDA を高速化、最適化するためは、Pascal Architecture に対応した最新の CUDA + ドライバー が理想的

GeForce GTX 1050 (6.1, 4,2GB GDDR5, 768,640 Core, 1354 - 1445 MHz, TDP 75W~)

GeForce GTX 1060 (6.1, 6,3,2GB GDDR5, 1280,1152,1024Core, 1506 - 1708 MHz, TDP 120W~)

GeForce GTX 1070 (6.1, 8GB GDDR5, 1920 Core, 1506 - 1708 MHz, TDP 150W~200W) 1809 EOL

GeForce GTX 1080 (6.1, 8GB GDDR5, 2560 Core, 1607 - 1733 MHz, TDP 180~200W) 1809 EOL

NVIDIA TITAN X (6.1, 12GB GDDR5X, 3584 Core, 1417 - 1531 MHz, TDP 約250W~) 1809 EOL

(GTX の付いた GTX TITAN X は、Pascal ではなく、Maxwell アーキテクチャー となりますので、ご注意ください)

GeForce TITAN Xp (6.1, 12GB GDDR5x, 3840 Core, 1,582 MHz, 384bit, 547.7GB/s, 12TFLOPS, 7680x4320@60Hz, TDP 250W)

GeForce GTX 1080 Ti (6.1, 11GB GDDR5, 3584 Core, 1480 - 1582 MHz, 352bit, 484GB/s, TDP 250W)

GeForce GTX 1050 Ti (6.1, 4GB GDDR5, 768 Core, 1290 - 1390 MHz, 128bit, TDP 75W)

・NVIDIA® Quadro® GPU

http://www.nvidia.co.jp/object/quadro-jp.html

NVIDIA Quadro GV100 (6.0, 32GB HMB2, 5120 Core, 4096bit, 870GB/s, 250W, ECC対応, DP 1.4x4)

NVIDIA Quadro GP100 (6.0, 16GB HMB2, 3584 Core, 4096bit, 732GB/s, 235W, ECC対応, DVI-Ix1, DP 1.4x4)

NVIDIA Quadro P6000 (6.1, 24GB GDDR5X, 3840 Core, 384bit, 433GB/s, 250W, ECC対応, DVI-Ix1, DP 1.4x4)

NVIDIA Quadro P5000 (6.1, 16GB GDDR5X, 2560 Core, 256bit, 288GB/s, 180W, ECC対応, DVI-Ix1, DP 1.4x4)

NVIDIA Quadro P4000 (6.1, 16GB GDDR5, 1792 Core, 256bit, 243GB/s, 105W, ECC対応, DP 1.4x4)

NVIDIA Quadro P2000 (6.1, 5GB GDDR5, 1024 Core, 160bit, 140GB/s, 75W, ECC対応, DP 1.4x4)

NVIDIA Quadro P1000 (6.1, 4GB GDDR5, 640 Core, 128bit, 80GB/s, 47W, ECC対応, Mini DP 1.4x4)

NVIDIA Quadro P600 (6.1, 2GB GDDR5, 384 Core, 128bit, 64GB/s, 40W, ECC対応, Mini DP 1.4x4) EOL

NVIDIA Quadro P400 (6.1, 2GB GDDR5, 256 Core, 64bit, 32GB/s, 30W, ECC対応, Mini DP 1.4x3)

・NVIDIA® Tesla™ GPU

http://www.nvidia.co.jp/object/quadro-jp.html

Tesla V100 (7.0, 5120 Core, 7TFLOPS(DP), 14TFLOPS(SP), 18.7TFLOPS(HP), 112TFLOPS(DL), 16GB CoWoS HBM2 with ECC, 4096 bit, 1245-1380MHz, 900 GB/s) EOL

Tesla V100 (7.0, 5120 Core, 7TFLOPS(DP), 14TFLOPS(SP), 18.7TFLOPS(HP), 112TFLOPS(DL), 32GB CoWoS HBM2 with ECC, 4096 bit, 1230-1380MHz, 900 GB/s)

Tesla P100 for PCIe-Based (6.0, 4.7TFLOPS(DP), 9.3TFLOPS(SP), 18.7TFLOPS(HP), 16 or 12GB, 720 or 540 GB/s, ECC対応) EOL

Tesla P100 for NVLink-Optimized (6.0, 5.3TFLOPS(DP), 10.6TFLOPS(SP), 21.2TFLOPS(HP), 16GB, 720GB/s, ECC対応)

Tesla P40 (6.1, 12TFLOPS(SP), 47TOPS(INT8), 24GB, 346GB/s, 250W, ECC対応)

Tesla P4 (6.1, 5.5TFLOPS(SP), 22TOPS(INT8), 8GB, 192GB/s, 50/75W, ECC対応)

(SP:Single Precision 単精度, DP:Double Precision 倍精度, HP:Half Precision 半精度)

※NVIDIA® Deep Learning (深層学習) 開発環境に非対応なGPUの例

Tesla C2050 (2.0) / C2070 (2.0) / C2075 (2.0) / M20xx (2.0)

Qudro Plex 7000 (2.0)

Qudro NVS 310 (2.0) / NVS 315 (2.0) / NVS 4200M (2.1) / NSV 5200M (2.1)

GeForce GT 430 (2.1) / GT 430 (2.1) / GT 440 (2.1) / GTS 450 (2.1) / GTX 460 (2.1)

GeForce GT 550 Ti (2.1) / GT 560 Ti (2.1) / GTx 570 (2.0) / GTx 580 (2.0) / GTX 590x (2.0)

GeForce GT 610 (2.1) / GT 620 (2.1) / GT 630 (2.1) / GT 640 [GDDR3] (2.1)

(GeForce GT 640 GDDR3 は、 NVIDIA® のサイトでは 2.1 となっていましたが、 ELSA GeForce GT 640 LP 2GB GD640-2GERGL は、CUDA 「Device Query」 でチックしたところ 3.0 でした)

GeForce GT 730 [DDR3,128bit] (2.1)

|

_773x619.png)

_769x559.png)